K-folk bruger AI - men mange har ingen retningslinjer

Manglende retningslinjer kan gøre virksomheder og k-folk, der bruger kunstig intelligens, sårbare. Men stive regler kan samtidig være svære i en tid, hvor udviklingen går stærkt.

To år efter den generative kunstige intelligens’ folkelige gennembrud spejder mange kommunikatører fortsat langt efter interne retningslinjer på deres arbejdspladser.

Det viser en ny undersøgelse fra DM Kommunikation. Og eksperter genkender billedet.

"Medarbejderne bruger AI-løsninger i deres daglige arbejde, men organisationerne har ikke fundet ud af, hvordan de skal forholde sig til det," siger Andreas Holbak Espersen, der er digitaliseringspolitisk chef i Dansk Industri (DI).

Han fortsætter:

"Uden retningslinjer risikerer virksomhederne, at forretningskritiske data eller persondata bliver uploadet til åbne AI-modeller, og det kan skabe alvorlige sikkerhedsproblemer.

Maria Damborg Hald, der er partner og teknologileder hos Deloitte Consulting, siger:

"Virksomheder skal ikke bare fokusere på at beskytte deres data, men også sikre, at medarbejderne forstår deres ansvar, når de bruger AI-værktøjer," siger hun og tilføjer:

"Når der ikke er retningslinjer på plads, kan man ende med, at medarbejderne bruger AI uden at være klar over de risici, det medfører - og det kan have store konsekvenser."

Virksomheder tøver

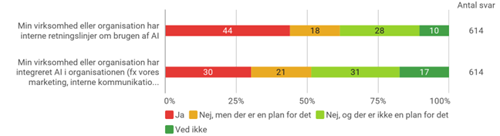

Konkret viser DM Kommunikations undersøgelse, at mindre end halvdelen af respondenterne - 44 procent - svarer ”ja” til at “min virksomhed har interne retningslinjer om brugen af AI”, mens 18 procent angiver, at der er “en plan for det”.

Og selv om den daglige brug af AI-værktøjer - i hvert fald på papiret - fortsat ikke er dominerende, så er behovet for retningslinjer til stede.

Ifølge Andreas Holbek Espersen er tallene endnu et tegn på, at en del virksomheder tøver med at tage beslutninger om AI, fordi de ikke er sikre på, om det er den rigtige teknologi, eller om de har kompetencerne til at vurdere det.

Men samtidig er teknologien taget i brug - og den er kommet for at blive. Han påpeger derfor, at AI ikke kun skal drives nedenfra og op af medarbejdere, men også kræver en overordnet strategi fra ledelsen.

"Der er et behov for, at organisationer får styr på, hvad de vil med AI, og det kræver uddannelse og klare retningslinjer, som medarbejderne kan følge," siger han og fortsætter:

"Retningslinjer skal ikke være for komplicerede, men de skal være der - ellers risikerer man, at medarbejderne begynder at bruge AI ukritisk, hvilket kan føre til fejl og databrud."

Han giver et konkret eksempel: “Lad være med at lægge noget ind i en åben AI-model, du ikke ville have det godt med at se åbent på internettet.”

Store risici

Ifølge Maria Damborg Hald er det “utroligt vigtigt at opsætte en governance-ramme tidligt, så man styrer medarbejdernes brug af AI på virksomhedens data."

"Hvis man ikke har klare retningslinjer, risikerer man, at følsomme data bliver delt eller brugt forkert, hvilket kan få alvorlige konsekvenser for virksomhedens omdømme," siger hun.

Maria Damborg Hald fremhæver især vigtigheden af at sikre, at datahåndtering i AI-platforme er i overensstemmelse med GDPR. Hun peger på derfor på nødvendigheden af, at virksomheder stiller sikre platforme til rådighed for medarbejderne, hvor dataen kan kontrolleres og sikres, så der ikke sker uforvarende databrud eller læk.

Og så er der løbende behov for at vurdere og opdatere de værktøjer, der anvendes, da AI ikke er en statisk teknologi, men noget, som kræver løbende evaluering og opdatering, forklarer hun:

“Det er vigtigt, at virksomheder har en plan for at vurdere, om de platforme, de bruger, stadig er effektive, sikre og i overensstemmelse med nye regler. Uden en klar strategi kan man miste kontrollen over, hvor virksomhedens data havner, og det kan være problematisk, især når AI-modellerne kører på cloud-tjenester uden for Europa," siger Maria Damborg Hald.

Skiftende virkeligheder

Alf Rehn, der er professor ved Institut for Teknologi og Innovation på Syddansk Universitet, SDU, er ikke decideret uenig i Andreas Holbak Espersen og Maria Damborg Halds pointer.

Men han tilføjer en række nuancer.

Der er en relativt stor gruppe, som angiver, at der ikke er retningslinjer for brugen af generativ AI det sted, hvor de arbejder. Hvad fortæller det dig?

“Vi befinder os i en tid, hvor det virker som om, at vi venter på, at der kommer nogen og fortæller os, hvordan vi skal bruge de her nye værktøjer,” siger Alf Rehn, der tilføjer:

“Jeg arbejder med det her hver dag, og jeg får minimum to til tre mail om nye værktøjer hver dag, som jeg kan bruge til alt muligt.”'

Så din pointe er: Hvorfor have retningslinjer for noget, som udvikler sig så hurtigt…

“Ja, for det er umuligt med de dynamikker, der er i virksomhederne. Jeg tror, at mange chefer og virksomhedsledere er lidt bange for at indføre for stramme retningslinjer, fordi de frygter at hæmme udviklingen i deres virksomhed. Der er hele tiden en skiftende virkelighed, som ledere ikke ønsker at blive fanget i,” siger Alf Rehn.

Men når der kommer så mange nye værktøjer, er det så ikke et argument i sig selv for, at der er nødt til at blive sat nogle rammer for, hvornår, hvorfor og hvordan man bruger AI?

“Det ville da være fint, hvis der var nogen, der var så kloge, at de kunne sætte præcise rammer. Men vi må huske, at vi befinder os i en konkurrencepræget verden. Det er fint, hvis en virksomhed siger, at ingen må bruge det eller det AI-værktøj, men hvad, hvis den så taber til en konkurrent, fordi konkurrenter er bedre til at bruge det?”

Alf Rehn fortsætter:

“Jeg siger ikke, at jeg ikke tror på retningslinjer. Jeg siger bare, at jeg tror, det er nødvendigt, at retningslinjerne ikke er absolutte, men derimod principbaserede. Det handler mere om at kommunikere, hvordan ledelsen ser på AI, og hvordan man som virksomhed ønsker at bruge det.”

Ifølge Alf Rehn har man derfor “brug for en filosofi snarere end håndfaste principper.”

“For når tingene ændrer sig så hurtigt, som de gør, vil vi stå i situationer, hvor vi må justere vores retningslinjer og principper,” siger han.

Det lyder som om, du sammenligner det lidt med internettets indtog?

“Præcis. Da internettet kom, var der direktører, der sagde: ‘Det her internet er noget, vi ikke skal bruge.’ De kunne ikke forestille sig, at det ville blive centralt for deres forretning. Det samme ser vi med AI. Teknologien ændrer sig ekstremt hurtigt, og vi har kun set begyndelsen. Hvis vi siger nej til at eksperimentere med det, risikerer vi at blive overhalet,” siger Alf Rehn.

Men vi har vel brug for ledere, der kan se ind i fremtiden og forme principperne?

“Ja, men vi skal også være realistiske. Vi kan ikke forvente, at nogen har svarene på, hvad der er de bedste retningslinjer om to eller fire år. Det her ændrer sig for hurtigt. Vi må skabe en åben dialog om, hvordan vi bruger AI bedst muligt. Og vi skal sikre, at vi ikke laver for stramme regler, der gør os bange for at bruge teknologien,” siger SDU-professoren.